Google a déployé récemment un nouveau rapport dans la Search Console dédié aux statistiques d’exploration de votre site par les robots Google : un ensemble de données disponibles dans l’ancienne Search Console et de données exclusives qui méritent le coup d’œil. Pour y accéder, il faudra par contre fouiller légèrement, le rapport étant disponible dans l’onglet « Paramètres » de la barre latérale gauche, puis « Statistiques de l’exploration ». Une petite mine d’or pour mieux comprendre comment Google perçoit votre site web que nous allons débriefer ensemble ici, très utile pour identifier les éventuels soucis de votre site et les corriger avec des actions techniques SEO adaptées.

Trois statistiques clés pour comprendre le crawl de votre site par les robots Google

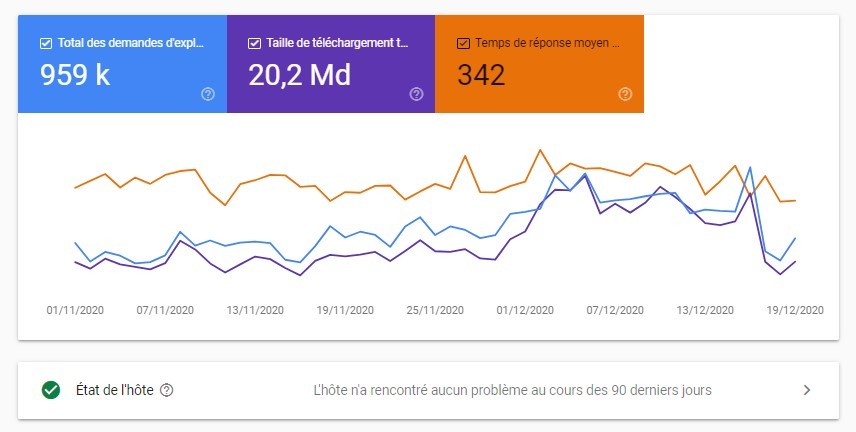

Le rapport s’ouvre avec un magnifique graphique à trois onglets à l’instar de ceux que l’on retrouve dans les autres sections de la Search Console. Ici, vous pourrez y retrouver trois éléments :

- Le volume total de demandes d’explorations du site lors de la période indiquée, soit le nombre de fois où un robot Google a parcouru votre site,

- Le volume total d’octets téléchargés par les robots Google lors de ces visites,

- Le temps de réponse moyen rencontrés par les robots lors de leurs explorations.

Vous pourrez soit observer la moyenne de ces valeurs sur la période étudiée, ou alors parcourir manuellement la courbe à disposition pour observer chaque résultat au jour le jour. Ces données permettent de mieux saisir comment les robots Google interagissent avec votre site au quotidien, mais permettent aussi de déceler d’éventuels soucis : par exemple, un temps de réponse qui augmenterait drastiquement sur une période donnée, signe d’un potentiel problème serveur à corriger.

Vous pourrez soit observer la moyenne de ces valeurs sur la période étudiée, ou alors parcourir manuellement la courbe à disposition pour observer chaque résultat au jour le jour. Ces données permettent de mieux saisir comment les robots Google interagissent avec votre site au quotidien, mais permettent aussi de déceler d’éventuels soucis : par exemple, un temps de réponse qui augmenterait drastiquement sur une période donnée, signe d’un potentiel problème serveur à corriger.

Un petit point sur l’état de santé de votre site (votre « hôte »).

Sous ce graphique figure un petit onglet vous alertant sur l’état de santé de votre hôte, soit de votre site web, ainsi que sa disponibilité sur les 90 derniers jours. Si les robots Google ont rencontré des soucis d’accès à votre site, cet onglet vous présentera précisément le type d’erreur rencontré : problème de connectivité serveur, indisponibilité du robots.txt, résolution DNS trop instable… Des résultats qui peuvent vous sembler obscurs à première vue, mais qui vous aideront vous et votre équipe de développement à optimiser la disponibilité de vos hôtes. Un élément à surveiller régulièrement pour palier à tout incident !

Les détails des demandes d’exploration, d’autres informations qui peuvent se révéler précieuses

Viennent ensuite plusieurs petits panels dont les données vous délivrent des informations clés sur votre site mais aussi la typologie et le comportement des crawlers Google qui le parcourent. Le détail « Par réponse », soit un tableau récapitulatif des status code rencontrés par les crawlers lorsqu’ils accèdent à une page. Vous pouvez ainsi connaître le volume de pages accessibles (code 2XX), en redirection (code 3XX) ou inaccessible (code 4XX) et ainsi corriger les éléments nécessaires si ces derniers prennent de fortes proportions.

Le détail « Par type de fichier » qui présente, comme son nom l’indique, les types de fichiers rencontrés par les GoogleBots : HTML, Image, CSS, JavaScript… Utile pour savoir si les robots accèdent bien vos différents formats de fichier ou identifier un format anormalement sur-représenté, ce qui pourrait indiquer un souci de crawl.

Le détail « Par objectif », qui présente la proportion de visites par les robots Google dont le but était d’actualiser l’indexation (détection et prise en compte d’une modification sur la page, par exemple) ou de découvrir une toute nouvelle page.

Enfin, le détail « Par type de GoogleBot » qui vous permet de déterminer quel user-agent (c’est-à-dire quel crawler Google) parcoure le plus votre site. Cela permet par la suite d’orienter votre stratégie SEO en fonction : par exemple, si le GoogleBot Smartphone crawle le plus votre site, vous avez tout intérêt à maximiser votre responsivité et vos performances de chargement mobile pour booster votre référencement naturel.

Vous pourrez soit observer la moyenne de ces valeurs sur la période étudiée, ou alors parcourir manuellement la courbe à disposition pour observer chaque résultat au jour le jour. Ces données permettent de mieux saisir comment les robots Google interagissent avec votre site au quotidien, mais permettent aussi de déceler d’éventuels soucis : par exemple, un temps de réponse qui augmenterait drastiquement sur une période donnée, signe d’un potentiel problème serveur à corriger.

Vous pourrez soit observer la moyenne de ces valeurs sur la période étudiée, ou alors parcourir manuellement la courbe à disposition pour observer chaque résultat au jour le jour. Ces données permettent de mieux saisir comment les robots Google interagissent avec votre site au quotidien, mais permettent aussi de déceler d’éventuels soucis : par exemple, un temps de réponse qui augmenterait drastiquement sur une période donnée, signe d’un potentiel problème serveur à corriger.